실리콘부터 시스템·랙·대규모 클러스터까지 개방형 설계 철학 구현

AMD가 OCP, UALink™, UEC 등 오픈 표준을 기반으로 AI 인프라의 미래를 공동으로 설계하며, 개방성과 상호운용성, 지속 가능한 혁신을 실현하고 있다.

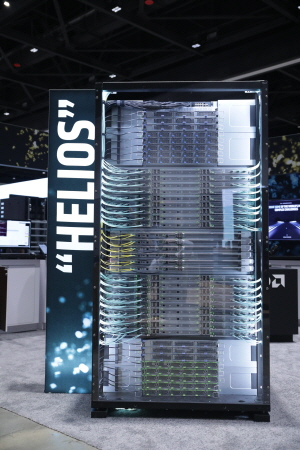

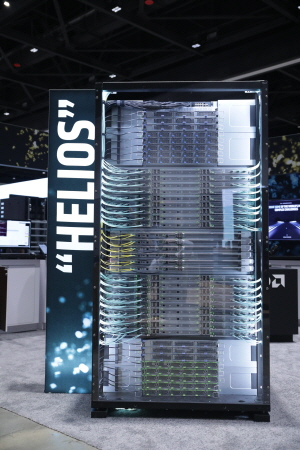

AMD는 14일 2025 OCP 글로벌 서밋에서 차세대 AI 데이터센터를 위한 오픈 랙 기반의 AI 인프라 시스템 ‘Helios’를 공개했다.

Meta가 제안한 2025년형 Open Rack Wide(ORW) 사양을 기반으로 설계된 Helios는 업계 전반의 개방형 인프라 혁신을 가속화할 핵심 플랫폼으로 주목받고 있다.

ORW는 AI 스케일 데이터센터의 전력·냉각·서비스 요구에 최적화된 더블 와이드 랙 사양으로, 표준화·상호운용성·확장성을 갖춘 인프라 설계를 가능하게 한다.

AMD는 이 사양을 기반으로 Helios 랙을 개발해 실리콘부터 시스템, 랙, 대규모 클러스터까지 개방형 설계 철학을 구현했다.

Helios는 AMD Instinct™ MI450 시리즈 GPU를 중심으로 구성되며, 각 GPU는 최대 432GB의 HBM4 메모리와 19.6TB/s의 대역폭을 제공한다.

랙 전체 기준으로는 72개의 MI450 GPU가 최대 1.4 엑사FLOPS(FP8), 2.9 엑사FLOPS(FP4)의 성능을 구현하며, 총 31TB 메모리와 1.4PB/s의 대역폭을 지원한다.

이는 트릴리언 파라미터 모델 학습과 대규모 추론을 위한 성능 기준을 새롭게 정의한다.

Helios는 260TB/s의 스케일업 인터커넥트 대역폭과 43TB/s의 이더넷 기반 스케일아웃 대역폭을 제공해 GPU, 노드, 랙 간의 원활한 통신을 보장한다.

이전 세대 대비 최대 17.9배의 성능 향상과 NVIDIA Vera Rubin 시스템 대비 50% 높은 메모리 용량과 대역폭을 실현했다.

Helios는 고밀도 AI 환경에서의 배치와 관리 효율을 고려해 설계됐다.

주요 특징을 살펴보면 더블 와이드 구조로 무게 밀도 감소 및 서비스성이 향상됐고, 표준 이더넷 기반 스케일아웃으로 다중 경로 복원력을 확보했다.

여기에 후면 퀵 디스커넥트 액체 냉각으로 고밀도 열 관리를 최적화했다.

Helios는 단순한 하드웨어를 넘어 AI 생태계 협업을 위한 설계 청사진이다. OEM 및 ODM 파트너는 Helios 레퍼런스 디자인을 채택·확장해 AI 시스템 개발을 가속화할 수 있으며, AMD Instinct™ GPU, EPYC™ CPU, Pensando™ DPU를 통합해 차별화된 솔루션을 구축할 수 있다.

2026년 양산 예정 Helios는 현재 OEM 및 ODM 파트너에게 레퍼런스 디자인으로 제공 중이며, 2026년부터 본격적인 양산이 시작될 예정이다.

AMD가 OCP, UALink™, UEC 등 오픈 표준을 기반으로 AI 인프라의 미래를 공동으로 설계하며, 개방성과 상호운용성, 지속 가능한 혁신을 실현하고 있다.

AMD가 OCP, UALink™, UEC 등 오픈 표준을 기반으로 AI 인프라의 미래를 공동으로 설계하며, 개방성과 상호운용성, 지속 가능한 혁신을 실현하고 있다.