대형 LLM 경량화 경쟁 속 ‘MoE 특화’ 양자화 결과 공개

대형언어모델(LLM)을 현장 디바이스나 제한된 GPU 환경에서 돌리려는 수요가 늘면서, 모델 정확도를 크게 훼손하지 않으면서도 메모리 사용량을 낮추는 ‘양자화(Quantization)’ 기술 경쟁이 치열해지고 있다.

노타는 3월 5일 업스테이지의 ‘Solar-Open-100B’에 자사 양자화 기법을 적용해 메모리 사용량을 줄였다고 밝혔다.

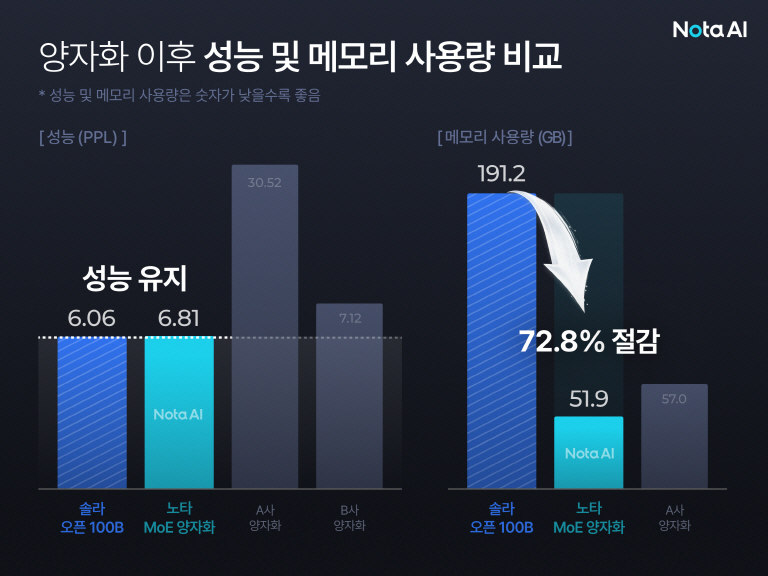

노타가 허깅페이스에 공개한 모델 카드에 따르면, ‘Nota MoE Quantization’을 적용한 Solar-Open-100B의 모델 가중치 메모리 풋프린트는 191.2GB에서 51.9GB로 제시됐다. 같은 페이지는 이 접근이 MoE(Mixture of Experts, 전문가 혼합) 구조 기반 LLM에서 전문가(Expert)들이 섞이는 과정에서 발생할 수 있는 **표현 왜곡(distortion)**을 완화하도록 설계됐다고 설명했다.

성능 지표로는 **PPL(Perplexity)**이 함께 제시됐다. 모델 카드의 표에서 위키텍스트-2(WikiText-2) 기준 PPL은 원본 Solar-Open-100B가 6.06, 노타 기법 적용 모델이 6.81로 표시됐다. PPL은 값이 낮을수록 언어모델의 예측이 더 안정적이라는 의미로 쓰인다.

이번 공개는 MoE 계열 LLM이 확산되는 상황에서, “모델 전체를 일괄적으로 줄이는 방식”을 넘어 구조 특성을 고려한 양자화 접근이 실제 모델 카드 수준의 지표로 제시됐다는 점에서 주목된다. 다만 과기정통부의 ‘독자 AI 파운데이션 모델’ 프로젝트 연계와 특허 출원 여부 등은 일부 언론 보도로도 소개됐으며, 관련 사실은 기사·공개자료 기준으로 확인 범위가 갈릴 수 있다.