인프라 변경 없이 쓰는 ‘MI350P PCIe’ GPU 공개

기업들의 인공지능(AI) 도입이 가속화되는 가운데, AMD가 기존 데이터센터 인프라를 그대로 활용할 수 있는 엔터프라이즈용 GPU를 선보였다. 대규모 설비 교체 없이 온프레미스 환경에서 AI 추론을 운영하려는 수요를 겨냥한 제품이다.

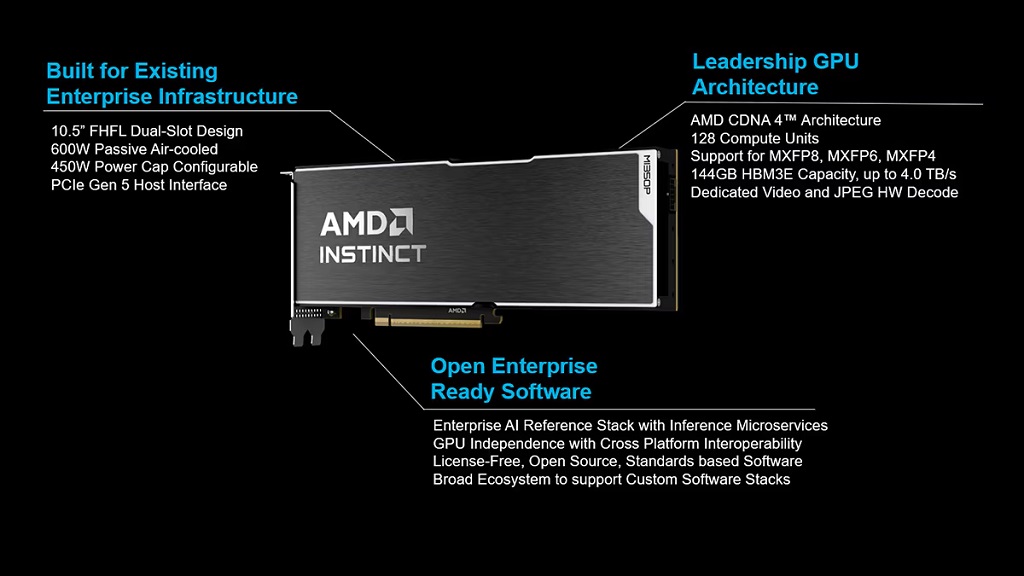

AMD는 7일 엔터프라이즈 AI를 위한 ‘AMD 인스팅트(Instinct) MI350P PCIe’ GPU 카드를 공개했다. 해당 제품은 표준 PCIe 기반 카드 형태로 설계돼, 기존 공랭식 서버 랙과 전력·냉각 환경에서 바로 사용할 수 있도록 했다.

MI350P PCIe 카드는 듀얼 슬롯 PCIe 폼팩터를 채택했다. 별도의 GPU 가속기 전용 플랫폼 구축 없이 기존 서버에 장착해 AI 추론 워크로드를 처리할 수 있다는 점이 특징이다. AMD는 이를 통해 클라우드 이전에 따른 비용과 데이터 프라이버시 우려, 대규모 온프레미스 업그레이드 부담 사이의 대안이 될 수 있다고 설명했다.

AMD에 따르면 해당 카드는 최대 8개의 가속기를 장착하는 공랭식 시스템 구성에서도 활용 가능하다. 이에 따라 소형부터 대형까지 다양한 AI 모델과 검색증강생성(RAG) 파이프라인의 추론 작업을 지원하도록 설계됐다.

MI350P PCIe는 CPU만으로는 부족하지만 대형 GPU 플랫폼 도입이 부담되는 기업 환경을 주요 적용 대상으로 한다. AMD는 이 제품이 엔터프라이즈 환경의 AI 도입 단계에 따라 유연한 선택지를 제공한다고 밝혔다.

주요 사양으로는 MXFP6·MXFP4 등 저정밀 연산 형식을 기본 지원해 높은 처리량을 제공하며, INT8·BF16 등 정밀도에서도 희소성(sparsity) 가속을 활용할 수 있다. AMD는 MXFP4 기준 최대 4,600TFLOPS의 피크 성능과 약 144GB HBM3E 메모리, 최대 4TB/s 수준의 메모리 대역폭을 제시했다.

AMD는 하드웨어뿐 아니라 소프트웨어 측면에서도 개방성을 강조했다. MI350P PCIe는 파이토치(PyTorch) 등 주요 AI 프레임워크를 네이티브로 지원하며, 쿠버네티스 GPU 오퍼레이터와 AI 추론 마이크로서비스 등 기존 엔터프라이즈 AI 스택과의 연동을 전제로 설계됐다.

AMD는 라이선스 비용이 없는 오픈소스 기반의 엔터프라이즈 AI 레퍼런스 스택을 파트너사에 제공한다는 방침이다. 이를 통해 코드 투명성을 높이고 운영 비용을 낮추면서, 온프레미스 환경에서도 추론 워크로드를 비교적 빠르게 운영할 수 있도록 지원한다고 설명했다.

AMD는 MI350P PCIe가 표준 공랭 데이터센터 환경에서 FP8, MXFP8, MXFP4 등 다양한 정밀도를 지원함으로써 전력과 냉각 요구를 최소화하도록 설계됐다고 밝혔다. 이를 통해 기업들이 코드 수정 없이 기존 AI 파이프라인을 이전하고, 이용자 수와 모델 수를 점진적으로 늘릴 수 있다는 설명이다.

AMD는 “AI 도입이 곧 인프라 전면 개편을 의미하지는 않는다”며 “기존 데이터센터 환경에서 AI 추론을 운영하려는 기업을 위한 현실적인 선택지”라고 전했다.